Od lamp próżniowych do fizyki cząstek – gdzie naprawdę zaczęła się historia

Odkrycie cząstek elementarnych nie zaczęło się od potężnych akceleratorów, lecz od niepozornych rur ze szkła, pomp próżniowych i baterii. Pierwsze eksperymenty z elektrycznością w rozrzedzonych gazach otworzyły drogę do zrozumienia, że materia składa się z mniejszych składników, niż atomy, które przez stulecia uważano za niepodzielne. Lampy próżniowe stały się jednocześnie narzędziem badawczym i technologiczną rewolucją – z nich wyrosła zarówno elektronika, jak i nowoczesna fizyka cząstek.

Proces, który prowadzi od lamp próżniowych do Wielkiego Zderzacza Hadronów, to opowieść o tym, jak ludzkość stopniowo „rozkręcała śrubki” w strukturze materii. Każdy etap wymagał nowego typu aparatury, nowych metod pomiaru i nowych idei teoretycznych. Pierwsze ślady elektronów, protonów i jąder rejestrowano na płytkach fotograficznych, ekranach fluorescencyjnych czy kliszach w komorach mgłowych. Współczesne detektory w LHC zapisują miliony zderzeń na sekundę w formie danych cyfrowych, ale cel pozostał ten sam: ustalić, jakie cząstki elementarne istnieją i jak działają prawa rządzące ich zachowaniem.

Historia odkrywania cząstek elementarnych to także historia coraz większych energii i coraz krótszych skal. Aby „zobaczyć” strukturę wewnętrzną atomu czy protonu, trzeba uderzyć w niego inną cząstką z ogromną energią – podobnie jak w mikroskopie elektronowym używa się elektronów zamiast światła. Im wyższa energia zderzeń, tym mniejsze szczegóły struktury można badać. Ta prosta zasada prowadzi wprost od pierwszych lamp próżniowych do potężnych akceleratorów, które zajmują dziesiątki kilometrów pod ziemią.

Lampy próżniowe i promienie katodowe – narodziny elektronu

Eksperymenty z wyładowaniami w gazach

Pod koniec XIX wieku laboratoria w całej Europie wypełniały się dziwnym światłem: zielonkawymi poświatami, smugami świecącego gazu i jasnymi punktami na ekranach fluorescencyjnych. Były to efekty wyładowań elektrycznych w rozrzedzonych gazach, badanych w szklanych rurach, które dziś określa się jako lampy próżniowe lub rury wyładowcze. Naukowcy tacy jak Heinrich Geissler czy Julius Plücker konstruowali coraz doskonalsze pompy, pozwalające obniżać ciśnienie w rurach i obserwować, jak zmienia się charakter wyładowania.

Wraz z obniżaniem ciśnienia tradycyjna iskra przestawała przypominać błyskawicę, a zamieniała się w rozmytą, świecącą poświatę. Pojawiały się ciemne obszary (np. ciemnia Crookesa), a przy odpowiednich warunkach z katody (elektrody ujemnej) zaczynały „wybiegać” w stronę ścian rur wiązki niewidocznego promieniowania, które ujawniały się dopiero wtedy, gdy trafiały w ekran fluorescencyjny. Te wiązki nazwano promieniami katodowymi.

Najważniejsze pytanie brzmiało: czym są promienie katodowe? Czy to forma światła, zaburzenia w eterze, a może strumień cząstek? Dopóki nie potrafiono ich zgiąć w polu elektrycznym lub magnetycznym, trudno było rozstrzygnąć spór. Z czasem okazało się jednak, że promienie katodowe dają się odchylać jak ładunki elektryczne, co sugerowało ich cząstkową naturę.

Przełomowe znaczenie miało także to, że promienie katodowe pojawiały się niezależnie od rodzaju gazu w rurze czy materiału elektrod. Wskazywało to, że ich źródłem jest coś wspólnego dla wszelkiej materii – sygnał, że w atomach istnieje uniwersalny, ujemnie naładowany składnik.

Eksperymenty J. J. Thomsona i identyfikacja elektronu

Joseph John Thomson w latach 90. XIX wieku wykorzystał rury próżniowe do precyzyjnych badań promieni katodowych. Kluczowy pomysł polegał na jednoczesnym zastosowaniu pola elektrycznego i magnetycznego oraz pomiarze stopnia odchylenia wiązki. Pozwoliło to obliczyć stosunek ładunku do masy (e/m) cząstek tworzących promienie katodowe.

Thomson uzyskał wartość e/m znacznie większą niż dla jakiegokolwiek jonu znanego z elektrolizy, z czego wniósł, że te cząstki są albo niezwykle lekki, albo mają wielki ładunek. Dalsze analizy i eksperymenty wykazały, że chodzi o nowe, uniwersalne składniki atomów – cząstki ujemne, które później nazwano elektronami. Thomson pokazał też, że niezależnie od rodzaju gazu czy materiału katody, stosunek e/m jest ten sam, co oznaczało, iż elektron jest częścią składową wszelkiej materii.

W tym momencie atom przestał być niepodzielny. Thomson zaproponował model „ciasta z rodzynkami”: dodatnio naładowana „masa” rozciąga się na cały atom, a w niej tkwią lekkie, ujemne elektrony. Choć ten model okazał się później błędny, był ważnym krokiem do zrozumienia budowy atomu i pierwszym uznaniem istnienia cząstek elementarnych w sensie podatomowym.

Odkrycie elektronu miało natychmiastowe konsekwencje technologiczne: lampy próżniowe zaczęto wykorzystywać nie tylko jako obiekty badań, ale jako elementy aktywne w układach elektronicznych – diody, triody czy lampowe wzmacniacze, które zrewolucjonizowały technikę komunikacyjną pierwszej połowy XX wieku.

Znaczenie lamp próżniowych dla późniejszych eksperymentów

Lampy próżniowe dały fizykom coś więcej niż sam elektron. Były pierwszym narzędziem pozwalającym kontrolować strumień cząstek: można było go włączać, wyłączać, ogniskować i odchylać. To właśnie w lampach próżniowych:

- uczono się, jak tworzyć wiązki cząstek o określonej energii i kierunku,

- ćwiczono technikę wysokiej próżni, kluczową dla akceleratorów,

- badano oddziaływanie pól elektrycznych i magnetycznych na cząstki naładowane,

- doskonalono metody detekcji – od ekranów fluorescencyjnych po wczesne liczniki.

Bez doświadczeń z promieniami katodowymi nie powstałyby mikroskopy elektronowe, pierwsze akceleratory liniowe ani analiza rozpraszania elektronów na atomach. Ścieżka prowadząca do odkrycia struktury jądra i cząstek hadronowych zaczyna się właśnie w tych skromnych, szklanych rurach.

Od elektronu do jądra: rozpraszanie i odkrycie protonu

Eksperyment Millikana i „parametry” elektronu

Sam fakt istnienia elektronu nie wystarczał – potrzebne było poznanie jego podstawowych własności: ładunku i masy. Robert Millikan w słynnym eksperymencie z kroplami oleju wykorzystał pole elektryczne do „zawieszania” naładowanych kropelek w powietrzu. Z równowagi między siłą grawitacji a siłą elektryczną wyznaczył elementarny ładunek elektryczny e.

Połączenie wyniku Millikana (wartości e) z pomiarem e/m Thomsona pozwoliło wyliczyć masę elektronu. Otrzymano cząstkę około 2000 razy lżejszą od najlżejszego znanego jonu wodoru. To był ważny argument, że większość masy atomu nie może znajdować się w elektronach – musiała być skupiona w innej jego części, jeszcze nieznanej.

Ten zestaw parametrów – ładunek, masa, stosunek e/m – stał się standardem opisu cząstek naładowanych. Później w podobny sposób określano własności jonów, protonów, deuteronów czy mionów, a technika analizy trajektorii w polach magnetycznych trafiła do mas spektrometrów oraz detektorów w akceleratorach.

Doświadczenie Rutherforda i narodziny jądra atomowego

Gdy Thomson badał elektrony, Wilhelm Röntgen odkrył promienie X, a Henri Becquerel – promieniowanie naturalne (radioaktywność), rozwijane później przez Marię Skłodowską-Curie. Z radioaktywnych źródeł pochodziły cząstki alfa, które okazały się idealnym narzędziem do „sondowania” wnętrza atomów.

Ernest Rutherford i jego współpracownicy Hans Geiger i Ernest Marsden przeprowadzili doświadczenie z rozpraszaniem cząstek alfa na cienkiej złotej folii. Spodziewano się niewielkich odchyleń trajektorii, zgodnych z modelem „ciasta z rodzynkami”. Ku zaskoczeniu badaczy część cząstek alfa odbijała się pod dużymi kątami, a niektóre wracały prawie w stronę źródła.

Jedynym sensownym wytłumaczeniem było założenie, że dodatni ładunek, a także prawie cała masa atomu, są skupione w niewielkim, gęstym obszarze – jądrze atomowym. Elektrony krążą wokół tego jądra, podobnie jak planety wokół Słońca. Rutherford zbudował więc obraz atomu, który stał się fundamentem dalszej fizyki jądrowej i cząstek elementarnych.

To doświadczenie było jednocześnie jednym z pierwszych przykładów zastosowania techniki „rozpraszania cząstek” jako metody badania struktury materii. W uproszczeniu: wysyłamy „pociski” (cząstki alfa, elektrony, protony) w materiał i analizując ich odchylenia oraz energie po zderzeniach, rekonstruujemy budowę wewnętrzną trafionego obiektu. Ta idea, rozwinięta do skali wysokich energii, leży u podstaw eksperymentów prowadzonych współcześnie w Wielkim Zderzaczu Hadronów.

Odkrycie protonu i pierwsze cząstki jądrowe

Analiza zderzeń cząstek alfa z różnymi jądrami doprowadziła Rutherforda do wniosku, że istnieje dodatnio naładowana cząstka, lżejsza od alfa, stanowiąca podstawowy składnik jąder – proton. Wodór, najprostszy atom, ma jednoelektronową otoczkę i jedno dodatnie jądro; uznano więc, że jądro wodoru jest protonem. Inne jądra można było traktować jako zespoły protonów i elektronów, choć ten obraz okazał się niepełny (brakowało w nim neutronu).

Odkrycie protonu przesunęło poziom analizy w głąb materii. Zamiast abstrakcyjnego pojęcia ładunku dodatniego i ujemnego pojawiły się konkretne cząstki: elektron i proton. Pierwsza generacja fizyków cząstek elementarnych mogła zatem mówić o „elementach” struktury atomu w kategorii realnych obiektów, mających masę, ładunek i zdolność do zderzeń.

Jednocześnie pojawiały się pierwsze oznaki, że obraz ten jest zbyt prosty. Dane izotopów i widma promieniowania beta sugerowały, że wewnątrz jądra musi znajdować się coś jeszcze – składnik odpowiedzialny za masę, ale nie wnoszący ładunku elektrycznego.

Neutron, jądro i początek fizyki jądrowej

Poszukiwanie brakującej masy: narodziny neutronu

Różnice między masą jąder a prostym zliczaniem protonów wskazywały, że w jądrze obecne są neutralne składniki. Próby tłumaczenia wszystkiego jako „protony plus elektrony w jądrze” prowadziły do sprzeczności ze znanymi faktami, m.in. z momentami magnetycznymi jąder i energią wiązania.

James Chadwick w 1932 roku wykonał serię eksperymentów z bombardowaniem berylu cząstkami alfa. Zaobserwował promieniowanie, które nie dało się łatwo wytłumaczyć jako znane cząstki naładowane. Analiza zderzeń tego promieniowania z protonami wykazała, że odpowiadają mu ciężkie, elektrycznie obojętne cząstki – neutrony.

Neutron uzupełnił obraz jądra atomowego: jądro składa się z protonów (ładunek dodatni) i neutronów (brak ładunku), razem zwanych nukleonami. Elektrony przestały być potrzebne w jądrze – ich miejsce znajdowało się w otoczce atomowej. Równocześnie neutron, jako cząstka obojętna, stał się doskonałą „kulą bilardową” do sondowania jąder, ponieważ nie odpychał się elektrycznie od dodatnio naładowanego jądra.

Odkrycie neutronu otworzyło drogę do nowego typu eksperymentów z reakcjami jądrowymi, transmutacją pierwiastków i rozszczepieniem jądra uranu. Z punktu widzenia fizyki cząstek elementarnych ważne było to, że liczba „elementarnych cegiełek” wzrosła, a równocześnie pojawiło się pytanie: co utrzymuje protony i neutrony razem w jądrze, pokonując ich wzajemne odpychanie elektrostatyczne?

Siła jądrowa i pierwsze modele oddziaływań

By wyjaśnić spójność jądra, konieczne było wprowadzenie nowego rodzaju oddziaływania – siły jądrowej (silnej, choć wtedy jeszcze tak jej nie nazywano w dzisiejszym sensie). Yukawa zaproponował, że między nukleonami wymieniane są cząstki pośredniczące, tzw. mezony. Zasięg siły jądrowej miał wynikać z masy tych cząstek, zgodnie z relacją z teorii kwantowej.

Modele te nie były jeszcze pełną teorią oddziaływania silnego, jednak stworzyły ramy pojęciowe, w których zaczęto szukać nowych cząstek w promieniowaniu kosmicznym i w reakcjach jądrowych. Koncepcja „cząstki pośredniczącej” stała się jednym z filarów późniejszego Modelu Standardowego, w którym każdemu oddziaływaniu przypisuje się odpowiednie bozony wymiany (np. gluony, fotony, bozony W i Z).

Era akceleratorów: od cyklotronu do pierwszych zderzeń

Cyklotron Lawrence’a i narodziny „sztucznego promieniowania kosmicznego”

Rozwijająca się fizyka jądrowa szybko dotarła do granic możliwości naturalnych źródeł cząstek – promieniowania kosmicznego i radioaktywnych jąder. Konieczne stało się budowanie urządzeń, które potrafią rozpędzać naładowane cząstki do coraz większych energii w kontrolowany sposób. Pierwszym przełomowym krokiem był cyklotron opracowany przez Ernesta Lawrence’a na początku lat 30. XX wieku.

Cyklotron wykorzystuje pole magnetyczne, aby zakrzywiać tor ruchu cząstek w płaskiej komorze w kształcie litery „D” (tzw. dee). Pole elektryczne, zmieniające się w czasie, przyspiesza cząstki za każdym razem, gdy przelatują przez szczelinę między częściami komory. W efekcie poruszają się one po spiralnej trajektorii, zyskując energię przy każdym „okrążeniu”.

Takie urządzenie pozwoliło uzyskać wiązki protonów i deuteronów o energiach niemożliwych wcześniej do osiągnięcia w laboratorium. Zaczęto wytwarzać nowe izotopy, badać reakcje jądrowe przy wyższych energiach i tworzyć coś, co Lawrence nazywał „sztucznym promieniowaniem kosmicznym”. W pewnym sensie każdy akcelerator jest zminiaturyzowaną wersją kosmosu, w którym zderzenia cząstek można inicjować i obserwować na żądanie.

Cyklotron wyznaczył też ważny wzorzec technologiczny: konieczność precyzyjnej kontroli próżni, silnych magnesów, stabilnych źródeł wysokiego napięcia oraz coraz bardziej wyszukanych detektorów. Wszystkie te elementy – udoskonalone i zminiaturyzowane – widać później w akceleratorach liniowych, synchrotronach i wreszcie w Wielkim Zderzaczu Hadronów.

Synchrotrony i tunelowe „mikroskopy wysokich energii”

Wraz ze wzrostem energii pojawił się problem rosnącej masy relatywistycznej cząstek: proste zwiększanie częstotliwości w cyklotronie przestało działać. Rozwiązaniem było zsynchronizowanie częstotliwości pola przyspieszającego z rzeczywistą częstotliwością obiegu cząstek – tak narodził się synchrotron. Zamiast jednej, dużej komory w kształcie litery „D”, zastosowano pierścień przyspieszający z rozmieszczonymi wokół niego wnękami rezonansowymi i magnesami kierującymi wiązkę.

Synchrotrony umożliwiły budowę akceleratorów o średnicach setek metrów, a później kilku kilometrów. Protony, elektrony i inne jony mogły krążyć w nich tysiące razy na sekundę, przyspieszając przy każdym przejściu przez wnęki RF (radiowe pola wysokiej częstotliwości). W ten sposób udało się przekroczyć kolejne bariery energetyczne bez konieczności stosowania nierealistycznie długich akceleratorów liniowych.

Z perspektywy badań cząstek każdy wzrost energii oznaczał zwiększenie „rozdzielczości mikroskopu”. Krótsza długość fali de Broglie’a wiązki sondującej pozwalała zobaczyć drobniejsze struktury: najpierw jądra, potem wewnętrzną budowę nukleonów, aż po kwarki i gluony. Idea jest analogiczna do mikroskopii optycznej – aby zobaczyć drobniejsze detale, potrzeba światła o krótszej długości fali – tyle że w świecie cząstek „światłem” stają się wysokoenergetyczne protony lub elektrony.

Akceleratory liniowe: prosta droga do wielkich energii

Równolegle rozwijano akceleratory liniowe (linaki), w których cząstki przechodzą w jednej linii przez kolejne sekcje przyspieszające. W każdej sekcji pole elektromagnetyczne „popycha” wiązkę, dodając jej niewielką porcję energii. Sumarycznie, po przejściu przez długi ciąg wnęk, cząstki osiągają ogromne prędkości i energie.

Linaki mają kilka istotnych zalet. Dają bardzo dobrze zdefiniowaną wiązkę o jednorodnej energii i stosunkowo małych stratach na promieniowanie synchrotronowe (szczególnie dla cięższych cząstek). Łatwo też dobudowywać kolejne sekcje, zwiększając maksymalną energię. Z tego powodu dziś linaki są wykorzystywane nie tylko w wielkich laboratoriach, ale też w medycynie – w terapii nowotworów oraz w diagnostyce – i w przemyśle.

W kontekście drogi do LHC ważne jest, że akceleratory liniowe bardzo często pełnią rolę „wstrzeliwujących” wiązek do większych pierścieni. W kompleksie CERN wiązki protonów czy jonów przechodzą przez całą drabinkę urządzeń: od źródeł jonowych, przez mniejsze synchrotrony i linaki, aż po główny pierścień zderzacza. To inżynieryjny odpowiednik systemu śluz i kanałów prowadzących statki do otwartego morza.

Rozkwit detekcji: od mgławicowej smugi do elektronicznych pikseli

Komora mgłowa Wilsona i fotografia śladów

Sama wiązka wysokoenergetycznych cząstek nie wystarczała – trzeba było jeszcze zobaczyć, co dzieje się podczas zderzeń. Jednym z pierwszych narzędzi pozwalających „zobaczyć” cząstki była komora mgłowa opracowana przez Charlesa Wilsona. Wypełniona przesyconą parą wodną komora reagowała na przechodzące cząstki naładowane: jonizowały one cząsteczkę gazu, do których przyklejały się krople kondensującej pary, tworząc widoczny ślad.

Krótka ekspansja gazu (obniżenie ciśnienia) powodowała przesycenie pary, a wtedy każdy tor cząstki stawał się liniową chmurką skroplonej wody. Dodanie pola magnetycznego pozwalało dodatkowo zakrzywiać te ślady, co dawało informację o ładunku i pędzie cząstek. Tak zarejestrowano wiele kluczowych zjawisk, w tym pierwsze przykłady par elektron–pozyton czy rozpadów mezonów.

Komora mgłowa łączyła fizykę z fotografią. Krótkie rozbłyski lamp błyskowych zamrażały obraz torów, a analizując negatywy, fizycy wyliczali własności cząstek. Choć dziś podobne rekonstrukcje wykonują algorytmy na milionach śladów jednocześnie, zasada – wyciąganie informacji o cząstce z kształtu i gęstości jej toru – pozostała ta sama.

Komora pęcherzykowa i wielkoskalowa fotografia cząstek

Kolejnym krokiem były komory pęcherzykowe Donalda Glasera. Wypełnione przegrzaną cieczą (najczęściej wodorem lub helem) urządzenia te działały na podobnej zasadzie jak komory mgłowe, ale zamiast kropelek pary powstawały w nich pęcherzyki gazu wzdłuż toru cząstki. Ich gęstość i kształt odzwierciedlały ilość energii traconej przez cząstkę na jonizację.

Komory pęcherzykowe można było budować w ogromnych skalach – wielometrowe zbiorniki zanurzone w silnych magnesach. Tysiące zderzeń rejestrowano jednocześnie, robiąc zdjęcia z kilku kamer umieszczonych wokół komory. Na jednym kadrze utrwalały się całe „fajerwerki” cząstek wtórnych powstających w zderzeniach wiązki z tarczą.

Analiza tych zdjęć wymagała dużego nakładu pracy. Zatrudniano całe zespoły osób do ręcznego śledzenia torów na kliszach, mierzenia ich krzywizn i punktów przecięcia. Ta „ręczna tomografia” doprowadziła do odkrycia wielu nowych cząstek – różnego rodzaju mezonów i barionów – które później trzeba było uporządkować w spójny schemat teoretyczny.

Detektory iskrowe, driftowe i przejście do elektroniki

Rozmiary komór pęcherzykowych i rosnące tempo rejestracji zderzeń wymusiły przejście na techniki całkowicie elektroniczne. Detektory iskrowe pozwalały rejestrować przechodzące cząstki jako zapalające się sekwencje iskierek wzdłuż ich toru. Jeszcze większy potencjał miały komory proporcjonalne i komory dryfowe, w których jonizacja gazu była zamieniana na impulsy elektryczne odczytywane przez systemy elektroniczne.

Zamiast oglądać zdjęcia, fizycy zaczęli odbierać strumień sygnałów cyfrowych. Informacje o pozycjach, czasie przejścia i energii zdeponowanej w detektorze były przetwarzane przez komputery, które rekonstruowały trójwymiarowe tory cząstek i ich interakcje. Powoli rodził się ekosystem, w którym fizyka cząstek stała się nierozerwalnie związana z informatyką, elektroniką cyfrową i techniką szybkich pomiarów.

Dzisiejsze detektory w LHC – takie jak ATLAS czy CMS – są bezpośrednimi spadkobiercami tych rozwiązań. W ich centrach znajdują się precyzyjne detektory krzemowe o strukturze pikselowej i paskowej, otoczone warstwami komór dryfowych i kalorymetrów. Zasada pozostała identyczna: zamienić ślad przechodzącej cząstki na zestaw sygnałów elektrycznych, które można zapisać, przeliczyć i zinterpretować.

Zoo cząstek i droga do kwarków

Promieniowanie kosmiczne: naturalny akcelerator wysoko nad głową

Zanim akceleratory osiągnęły naprawdę wysokie energie, Ziemia była nieustannie bombardowana przez naturalne wiązki cząstek – promieniowanie kosmiczne. Wysokoenergetyczne protony i jądra, pochodzące z odległych źródeł astrofizycznych, uderzają w atmosferę, produkując kaskady cząstek wtórnych.

Detektory umieszczane w górach, na balonach czy w samolotach rejestrowały ślady cząstek, które nie pasowały do znanego zestawu: elektron, proton, neutron, foton. Obserwowano cząstki cięższe od elektronów, lecz lżejsze od protonów, o różnych czasach życia i sposobach rozpadu. W komorach mgłowych i pęcherzykowych zaczęło pojawiać się całe „zoo” torów, które trzeba było nazwać i sklasyfikować.

Wśród tych nowości były miony (początkowo mylone z mezonami Yukawy), piony, kaony i liczne rezonanse barionowe. Promieniowanie kosmiczne pełniło rolę laboratorium, w którym przyroda przeprowadzała eksperymenty kolizyjne o energiach jeszcze przez lata niedostępnych dla człowieka. Dla teorii oznaczało to konieczność znalezienia nowego porządku w rosnącym katalogu cząstek.

Symetrie, „ośmioramienna droga” i narodziny kwarków

Kiedy liczba znanych hadronów (cząstek oddziałujących silnie) rosła, stało się jasne, że nie mogą być wszystkie fundamentalne. Podobnie jak widma chemiczne pierwiastków doprowadziły do uporządkowania ich w układ okresowy, tak właściwości mas, ładunków i czasów życia hadronów sugerowały istnienie ukrytej struktury.

Murray Gell-Mann i George Zweig zaproponowali, że hadrony można zbudować z kombinacji kilku bardziej fundamentalnych obiektów – kwarków. W pierwotnej wersji wystarczały trzy typy: up, down i strange. Z ich odpowiednich układów dało się odtworzyć wzory mas i ładunków obserwowanych baryonów i mezonów. Tzw. „ośmioramienna droga” (ang. eightfold way) była graficznym sposobem przedstawiania tych zależności w języku symetrii grupowych.

Początkowo kwarki traktowano głównie jako wygodne narzędzia matematyczne. Ich ładunki ułamkowe (np. +2/3, −1/3) wydawały się egzotyczne, a bezpośrednich obserwacji izolowanych kwarków nie było – i nadal nie ma, ze względu na zjawisko uwięzienia (konfinementu). Jednak w miarę jak akceleratory zaczęły dostarczać coraz wyższe energie elektronów i protonów, pojawiła się możliwość bezpośredniego „ostrzeliwania” protonów wiązkami elektronów i badania, co znajduje się w ich wnętrzu.

Rozpraszanie głęboko nieelastyczne: kwarki stają się „rzeczywiste”

W eksperymentach przeprowadzanych m.in. w SLAC (Stanford Linear Accelerator Center) wiązki wysokoenergetycznych elektronów kierowano na protony i neutrony. Zamiast prostego, elastycznego rozpraszania, w którym cząstki zachowują swoją strukturę, zaobserwowano zjawisko głęboko nieelastycznego rozpraszania: elektrony oddawały znaczną część swojej energii, a nukleony rozpadały się na wiele cząstek wtórnych.

Analiza kątów i energii rozproszonych elektronów sugerowała, że wewnątrz protonów i neutronów istnieją punktowe, niemal swobodne składniki – nazwane partonami. Gdy porównano te wyniki z modelem kwarków, okazało się, że partony mają dokładnie takie własności, jakich oczekiwano od kwarków w jądrze. To była mocna wskazówka, że kwarki są czymś więcej niż tylko konstrukcją matematyczną.

Dalsze badania doprowadziły do sformułowania chromodynamiki kwantowej (QCD) – teorii opisującej oddziaływania silne jako wymianę gluonów pomiędzy kwarkami, przy czym każdy kwark niesie tzw. „ładunek kolorowy”. QCD tłumaczy zarówno uwięzienie kwarków wewnątrz hadronów, jak i zjawisko asymptotycznej swobody, dzięki któremu przy bardzo wysokich energiach cząstki zachowują się tak, jakby były niemal swobodne.

Od pojedynczych wiązek do zderzaczy

Stałe cele kontra zderzające się wiązki

Początkowo większość eksperymentów wykonywano w geometrii „wiązkę na tarczę”: wysokoenergetyczne cząstki uderzały w nieruchomy cel złożony z atomów danego pierwiastka. W tej konfiguracji tylko część energii kinetycznej dostępna jest w układzie środka masy – reszta pozostaje jako ruch całego układu w jednym kierunku.

Zderzacze: wykorzystanie pełnej energii zderzenia

Rozwiązaniem ograniczeń geometrii „wiązkę na tarczę” okazały się zderzacze, czyli akceleratory, w których dwie wiązki cząstek o porównywalnych energiach poruszają się w przeciwnych kierunkach i zderzają czołowo. W takim układzie niemal cała energia kinetyczna dostępna jest w środku masy zderzenia, co pozwala tworzyć znacznie cięższe cząstki przy tej samej energii wiązki.

Technicznie wymaga to jednoczesnego przechowywania i kontrolowania dwóch wiązek w jednym lub dwóch pierścieniach, z dokładnym ustawieniem miejsc ich przecięcia. Magnetyczne układy ogniskujące („kwadrupole”) ściskają wiązki do mikroskopijnych rozmiarów, by zwiększyć prawdopodobieństwo zderzeń. W punkcie przecięcia wiązek powstaje „ognisko” fizyki – przestrzeń kilku centymetrów sześciennych, w której w ciągu sekundy mogą zachodzić miliony oddziaływań.

Pierwsze zderzacze dla elektronów i pozytonów, jak włoski ADONE czy francuski–radziecki VEP-1, pokazały, że koncepcja działa. Później pojawiły się zderzacze proton–antyproton i proton–proton, które otworzyły drogę do energii niedostępnych dla lżejszych elektronów ze względu na silne promieniowanie synchrotronowe.

Synchrotrony i ewolucja wielkich pierścieni

Wraz ze wzrostem energii, akceleratory liniowe stawały się niepraktycznie długie. Przejście do konstrukcji synchrotronowych – w których cząstki krążą wielokrotnie po zamkniętym torze, a energia jest im „dostrajana” impulsami elektrycznymi zsynchronizowanymi z ruchem – pozwoliło na kumulowanie energii krok po kroku.

Synchrotron to w istocie pierścień złożony z magnesów zakrzywiających tor wiązki i wnęk rezonansowych przyspieszających cząstki. Aby zapanować nad kształtem wiązki, stosuje się złożone układy ogniskowania wiązek, tzw. „silne ogniskowanie” (strong focusing), które wykorzystuje naprzemienne ustawienie magnesów skupiających i rozpraszających. Dzięki temu wiązka nie „rozlewa się” po całym tunelu, ale pozostaje w wąskim kanale próżniowym.

Największe akceleratory buduje się najczęściej w podziemnych tunelach o obwodach liczących dziesiątki kilometrów. W ich wnętrzu panują warunki lepszej próżni niż w przestrzeni kosmicznej, a magnesy – coraz częściej nadprzewodzące – działają w temperaturach ciekłego helu. W tych warunkach można uzyskać pola magnetyczne rzędu kilku tesli, konieczne do utrzymania na okrężnej orbicie protonów rozpędzonych niemal do prędkości światła.

Od protonów do jąder ciężkich

Równolegle do zderzaczy protonowych rozwijały się instalacje zdolne do przyspieszania jąder ciężkich, od helu po ołów czy złoto. Takie wiązki pozwalają badać materię w warunkach ekstremalnej gęstości energii. W zderzeniach jąder ciężkich powstaje plazma kwarkowo–gluonowa – stan materii, w którym kwarki i gluony nie są już „uwięzione” w poszczególnych protonach i neutronach, lecz tworzą gorącą, niemal idealnie płynną mieszaninę.

Akceleratory takie jak RHIC w Brookhaven czy program zderzeń ciężkich jąder w LHC badają właśnie te warunki. Analizuje się rozkłady pędów tysięcy cząstek powstających w jednym zderzeniu, anizotropię ich kątów oraz tzw. „tłumienie dżetów”, czyli osłabienie wysokoenergetycznych strug cząstek przechodzących przez gorącą plazmę. Te obserwacje dostarczają informacji o własnościach oddziaływań silnych w skali makroskopowej.

Standardowy Model: układ okresowy cząstek i oddziaływań

Porządkowanie cząstek: leptony, kwarki, bozony

Gdy liczba znanych cząstek i rezonansów sięgnęła setek, potrzebny był prosty, uniwersalny opis. Tak powstał Model Standardowy – teoria łącząca kwarkową strukturę materii z polami przenoszącymi oddziaływania. W jego ramach wszystkie „klocki” świata dzielą się na kilka grup.

Leptony to cząstki bez ładunku kolorowego: elektron, mion, taon oraz odpowiadające im neutrino elektronowe, mionowe i taonowe. Każdy z nich ma antycząstkę. Kwarki występują w sześciu odmianach (smakach): up, down, charm, strange, top i bottom. Noszą barwę (kolor) i uczestniczą w oddziaływaniach silnych, dzięki wymianie gluonów.

Oddziaływania opisuje się za pomocą bozonów pośredniczących: fotonu dla elektromagnetyzmu, gluonów dla siły silnej oraz bozonów W+, W− i Z0 dla oddziaływań słabych. Wspólną ramę matematyczną zapewniają teorie cechowania (gauge theories), w których symetrie lokalne wymuszają istnienie odpowiednich pól nośnikowych i określają ich sprzężenia z materią.

Dopełnieniem układu jest bozon Higgsa, związany z mechanizmem łamania symetrii elektrosłabej, który nadaje masę bozonowi Z, bozonom W oraz fermionom. Bez tego składnika Model Standardowy nie mógłby spójnie opisać zarówno masywnych, jak i bezmasowych cząstek w jednym formalizmie.

Elektrosłaba unifikacja i rola zderzaczy w jej potwierdzeniu

Kluczowym osiągnięciem teorii było połączenie oddziaływań elektromagnetycznych i słabych w jedną teorię elektrosłabą. Prace Glashowa, Weinberga i Salam pokazały, że foton oraz bozony W i Z są różnymi kombinacjami pól wynikających z jednej, bardziej ogólnej symetrii. Mechanizm Higgsa łamie tę symetrię w taki sposób, że foton pozostaje bezmasowy, a bozony słabe stają się ciężkie.

Teoria ta przewidywała istnienie bozonów W i Z o konkretnych masach i własnościach, ale do ich wytworzenia potrzebne były energie sięgające dziesiątek GeV. To wyzwanie przejęły akceleratory: najpierw SPS w CERN zaadaptowany jako zderzacz proton–antyproton, a później LEP jako precyzyjny zderzacz elektron–pozyton. Odkrycie bozonów W i Z w latach 80. potwierdziło elektrosłabą teorię, a dokładne pomiary w LEP-ie pozwoliły przetestować ją z niespotykaną dotąd dokładnością.

W praktyce oznaczało to setki milionów zderzeń rejestrowanych przez detektory wokół pierścienia, a następnie selekcję szczególnych sygnatur: par leptonów, dżetów hadronowych i neutrin (obecnych pośrednio jako brakująca energia). Oprogramowanie rekonstrukcyjne i statystyka stały się równie ważne jak same wiązki.

Tabela generacji i mas: hierarchie, których nie rozumiemy

Model Standardowy porządkuje fermiony w trzy generacje, z których każda jest kopią poprzedniej o większej masie. W codziennej materii pojawia się głównie pierwsza generacja (elektron, neutrina elektronowe, kwarki up i down), dwie kolejne generacje są wzbudzeniami pojawiającymi się w zderzeniach wysokoenergetycznych i w promieniowaniu kosmicznym.

Dlaczego istnieją dokładnie trzy generacje, a nie dwie czy pięć, i skąd biorą się ich masy – na te pytania Model Standardowy nie daje odpowiedzi. Parametry masowe wprowadza się ręcznie, dopasowując do danych eksperymentalnych. Ich pomiar – od precyzyjnej masy mionu po ekstremalnie ciężki kwark top – należał i nadal należy do głównych zadań akceleratorów.

LHC: Wielki Zderzacz Hadronów jako narzędzie do odkrywania

Architektura LHC: podziemny krąg na granicy możliwości

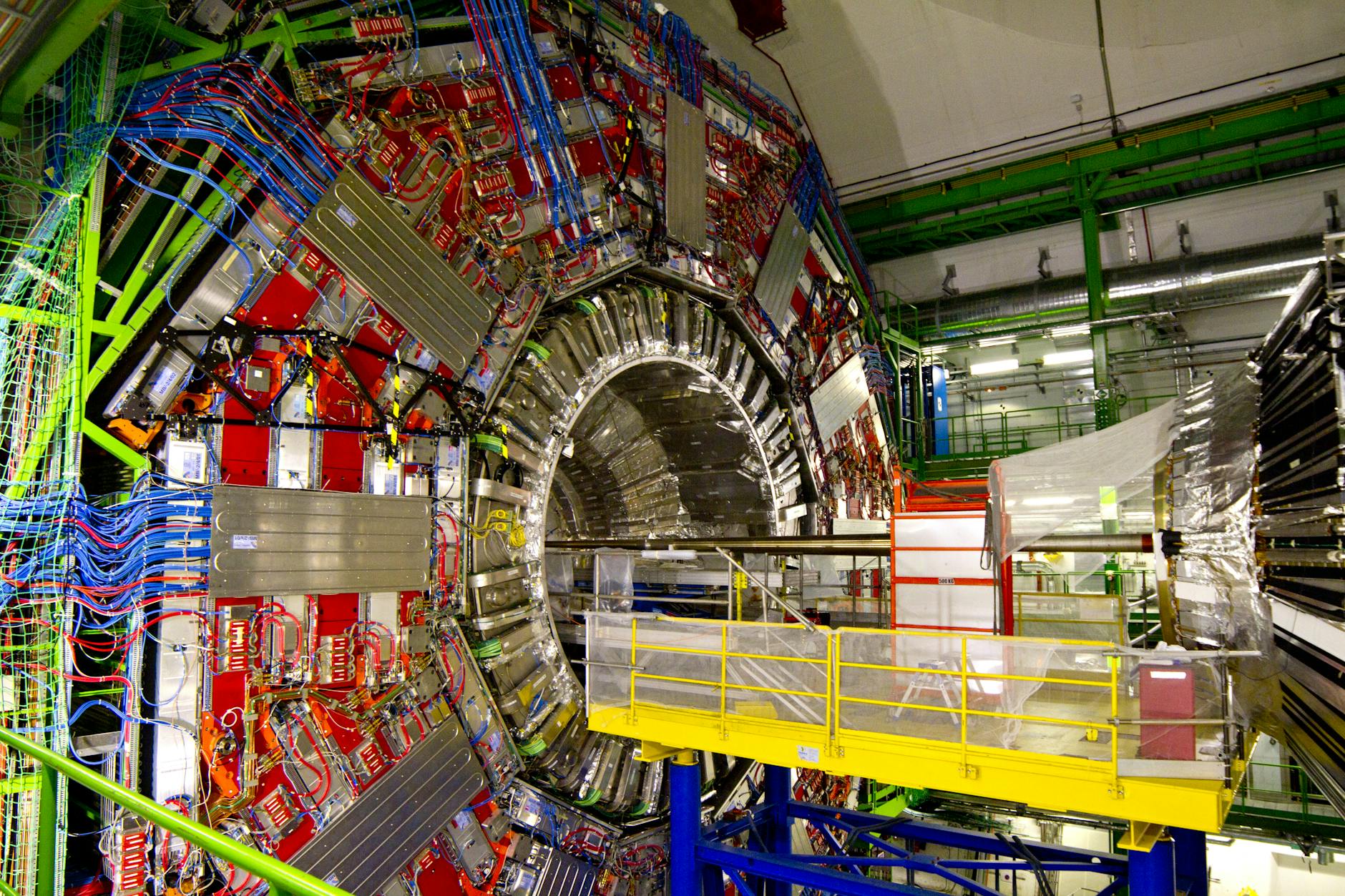

Wielki Zderzacz Hadronów (LHC) w CERN to kulminacja dziesięcioleci rozwoju technologii akceleratorów. Jego pierścień o długości blisko 27 km biegnie w tunelu wykorzystującym infrastrukturę po dawnym zderzaczu LEP, ale układ magnetyczny, system próżniowy i chłodzenie zostały zbudowane niemal od podstaw.

W LHC krążą dwie wiązki protonów poruszające się w przeciwnych kierunkach w dwóch sąsiednich rurach próżniowych. Utrzymują je nadprzewodzące magnesy dipolowe chłodzone ciekłym helem do temperatury kilku kelwinów. W wybranych czterech punktach pierścienia wiązki są krzyżowane i ogniskowane, tworząc miejsca zderzeń otoczone wielkimi detektorami: ATLAS, CMS, ALICE i LHCb.

Każda wiązka składa się z tysięcy skupisk (pęczków) protonów, które mijają się w punktach zderzeniowych co kilkadziesiąt nanosekund. Wtedy w objętości mniejszej niż ziarnko piasku mogą nastąpić dziesiątki jednoczesnych zderzeń. To stanowi wyzwanie nie tylko dla układów przyspieszających, ale przede wszystkim dla detektorów i systemów zbierania danych.

Detektory ogólnego przeznaczenia: warstwowe „kamery” 3D

ATLAS i CMS to detektory ogólnego przeznaczenia, zaprojektowane do rejestracji szerokiego spektrum procesów: od produkcji bozonu Higgsa po poszukiwania nowych cząstek. Ich budowa jest warstwowa. Najbliżej punktu zderzenia znajdują się detektory śladowe z krzemu (pikselowe i paskowe), które rejestrują krótkie tory naładowanych cząstek z dokładnością mikrometrów.

Dalej położone są kalorymetry elektromagnetyczne i hadronowe. Pierwsze zatrzymują elektrony i fotony, mierząc ich energię poprzez rozwój kaskad elektromagnetycznych, drugie mierzą energię hadronów (protonów, neutronów, pionów) poprzez kaskady hadronowe w gęstych materiałach absorberów. Najbardziej zewnętrzną warstwę stanowią detektory mionów, zdolne do rejestrowania cząstek przenikających przez całe wnętrze detektora.

Wszystko spina globalny system pola magnetycznego – solenoidowe lub toroidalne magnesy wytwarzające jednorodne pola o sile kilku tesli. Zakrzywienie torów naładowanych cząstek w tym polu pozwala wyznaczyć ich pęd. Kombinacja informacji z różnych poddetektorów tworzy pełny obraz zdarzenia: listę cząstek, ich pędy, ładunki i punkty powstania.

Systemy wyzwalania i analiza petabajtów danych

Przy nominalnym trybie pracy LHC generuje setki milionów zderzeń na sekundę. Zarejestrowanie surowych danych z każdego byłoby całkowicie nierealne, dlatego niezbędny jest wielostopniowy system wyzwalania (trigger). Pierwszy poziom, sprzętowy, działa w czasie rzędu mikrosekund i wybiera najbardziej obiecujące zdarzenia na podstawie prostych kryteriów: obecności wysokoenergetycznych mionów, fotonów, elektronów czy dużej energii poprzecznej.

Kolejne poziomy to już rozproszone systemy komputerowe, które w czasie od milisekund do sekund analizują większą ilość informacji z detektorów. Wykorzystują uproszczone algorytmy rekonstrukcji torów i dżetów, aby zdecydować, czy dane zdarzenie warto zachować. Z początkowych setek milionów zderzeń na sekundę ostatecznie zapisuje się jedynie ułamek procenta – ale i tak oznacza to wiele gigabajtów na sekundę.

Do przetwarzania tych danych powstała globalna infrastruktura GRID, łącząca centra obliczeniowe na całym świecie. Surowe dane są dystrybuowane, wielokrotnie kopiowane i analizowane przez tysiące fizyków. Typowy „analizator danych” spędza więcej czasu nad kodem i statystyką niż przy samym detektorze. Eksperyment w LHC to w praktyce wieloletnie przedsięwzięcie software’owe i organizacyjne.

Bozon Higgsa: brakujący element układanki

Jednym z głównych celów programu LHC było odkrycie bozonu Higgsa. Model Standardowy przewidywał jego istnienie, ale nie podawał dokładnej masy, pozostawiając jedynie pewien dozwolony zakres. Poprzednie akceleratory zawęziły ten zakres, lecz nie znalazły jednoznacznego sygnału.

W LHC bozon Higgsa powstaje głównie w zderzeniach protonów poprzez oddziaływania gluonów w ich wnętrzu. Ponieważ żyje niezwykle krótko, nie obserwuje się go bezpośrednio; rejestrowane są jego kanały rozpadu: na pary fotonów, bozony W i Z, pary mionów czy kwarków bottom. Każdy kanał ma własną sygnaturę i tło, które trzeba statystycznie odróżnić od zwykłych zderzeń.

Odkrycie bozonu Higgsa ogłoszono w 2012 roku, niemal równocześnie przez kolaboracje ATLAS i CMS. Sygnał pojawił się jako niewielki nadmiar zdarzeń o określonych energiach w kanałach z fotonami oraz z czterema leptonami. Statystyczna istotność przekroczyła konwencjonalny próg pięciu sigma, co w języku fizyki cząstek oznacza praktyczną pewność. Bozon Higgsa okazał się mieć masę około 125 GeV, czyli około 133 razy większą niż proton.

Testowanie granic Modelu Standardowego

Po odkryciu Higgsa jednym z głównych zadań LHC stało się precyzyjne badanie jego własności i poszukiwanie odchyleń od przewidywań Modelu Standardowego. Analizuje się częstości różnych kanałów rozpadu, sprzężenia Higgsa z innymi cząstkami, a także rzadkie procesy, takie jak produkcja pary bozonów Higgsa.

Najczęściej zadawane pytania (FAQ)

Jaką rolę odegrały lampy próżniowe w odkryciu cząstek elementarnych?

Lampy próżniowe były pierwszym narzędziem, które pozwoliło fizykom kontrolować strumień naładowanych cząstek – głównie elektronów. W szklanych rurach z rozrzedzonym gazem pojawiały się promienie katodowe, czyli wiązki niewidocznego promieniowania wychodzącego z katody, które można było odchylać polami elektrycznymi i magnetycznymi.

Dzięki tym eksperymentom wykazano, że promienie katodowe nie są światłem, lecz strumieniem cząstek o ujemnym ładunku – elektronów. Lampy próżniowe nauczyły fizyków tworzyć, ogniskować i sterować wiązkami cząstek, co stało się bezpośrednim preludium do powstania pierwszych akceleratorów i całej współczesnej fizyki cząstek.

Czym są promienie katodowe i dlaczego były tak ważne dla fizyki?

Promienie katodowe to strumień elektronów emitowanych z ujemnej elektrody (katody) w lampie próżniowej wypełnionej rozrzedzonym gazem. Same w sobie są niewidoczne, ale ich obecność zdradzają świecące ekrany fluorescencyjne lub poświata w gazie, na którą oddziałują.

Ich znaczenie polegało na tym, że umożliwiły wykazanie, iż istnieje uniwersalny, ujemnie naładowany składnik materii – elektron. Fakt, że promienie katodowe pojawiały się niezależnie od rodzaju gazu czy materiału elektrod, był mocnym argumentem, że atom nie jest niepodzielny i zawiera wspólne, podatomowe składniki.

Jak J. J. Thomson odkrył elektron w swoich eksperymentach?

J. J. Thomson badał promienie katodowe w rurach próżniowych, stosując jednocześnie pola elektryczne i magnetyczne. Mierząc, o ile odchyla się wiązka w znanych polach, wyznaczył stosunek ładunku do masy (e/m) cząstek tworzących promienie katodowe.

Okazało się, że e/m jest wielokrotnie większe niż dla jakiegokolwiek znanego jonu. To oznaczało, że cząstki te muszą być albo bardzo lekkie, albo mieć ogromny ładunek. Dalsze badania wykazały, że chodzi o lekkie, ujemne cząstki – elektrony – stanowiące uniwersalny składnik atomów. W ten sposób atom przestał być niepodzielny, a elektron stał się pierwszą uznaną cząstką elementarną.

Na czym polegał eksperyment Millikana z kroplami oleju i co nam powiedział o elektronie?

W eksperymencie Millikana naładowane elektrycznie krople oleju umieszczano między dwiema płytami kondensatora. Zmieniając natężenie pola elektrycznego, doprowadzano do sytuacji, w której siła elektryczna równoważyła ciężar kropli, co pozwalało wyznaczyć wartość elementarnego ładunku e.

Połączenie wyniku Millikana (ładunek elektronu) z pomiarem e/m Thomsona umożliwiło obliczenie masy elektronu. Wyszło, że jest około 2000 razy lżejszy od jonu wodoru. To pokazało, że niemal cała masa atomu musi być skupiona gdzie indziej niż w elektronach, co przygotowało grunt pod odkrycie jądra atomowego.

Jak odkrycie elektronu doprowadziło do powstania modeli budowy atomu?

Odkrycie elektronu zmusiło fizyków do porzucenia idei atomu jako niepodzielnej „kulki”. J. J. Thomson zaproponował model „ciasta z rodzynkami”: dodatnio naładowana „masa” rozciąga się na cały atom, a w niej tkwią ujemne elektrony.

Choć model ten okazał się później błędny (został zastąpiony przez model jądrowy Rutherforda i kolejne ujęcia kwantowe), był kluczowym etapem: po raz pierwszy wyobrażano sobie atom jako strukturę złożoną z mniejszych składników. To właśnie od takich prostych modeli rozpoczęła się dalsza droga do dzisiejszego obrazu atomu i cząstek elementarnych.

W jaki sposób rozwój lamp próżniowych przygotował grunt pod budowę akceleratorów i LHC?

Praca z lampami próżniowymi pozwoliła opanować kilka kluczowych technik, bez których akceleratory nie mogłyby powstać. Fizyków nauczono tam m.in.:

- jak wytwarzać i podtrzymywać wysoką próżnię,

- jak formować wiązki cząstek o kontrolowanej energii i kierunku,

- jak odchylać i ogniskować cząstki za pomocą pól elektrycznych i magnetycznych,

- jak je wykrywać za pomocą ekranów fluorescencyjnych, liczników i innych detektorów.

Te doświadczenia płynnie przeszły w konstrukcję pierwszych akceleratorów liniowych i cyklotronów, a w dalszej perspektywie – gigantycznych zderzaczy, takich jak Wielki Zderzacz Hadronów (LHC). Zasada pozostała ta sama: wykorzystać naładowane cząstki rozpędzone w polach elektrycznych i magnetycznych, by badać coraz głębszą strukturę materii.

Dlaczego do badania wnętrza atomu i protonu potrzebne są tak wysokie energie zderzeń?

Im mniejszy obiekt chcemy „zobaczyć”, tym krótsza musi być używana „fala” – w mikroskopie optycznym to światło, w fizyce cząstek są to np. elektrony lub inne cząstki. Krótsza długość fali odpowiada większej energii cząstek, dlatego do sondowania struktur wewnątrz atomu czy protonu trzeba używać bardzo wysokoenergetycznych zderzeń.

Ta zasada prowadzi od prostych lamp próżniowych, w których elektrony miały stosunkowo małe energie, do gigantycznych akceleratorów, takich jak LHC, gdzie cząstki rozpędza się niemal do prędkości światła. Każdy wzrost energii otwiera drogę do badania coraz mniejszych skal i odkrywania nowych cząstek elementarnych.

Najbardziej praktyczne wnioski

- Początki fizyki cząstek elementarnych sięgają prostych lamp próżniowych i rur wyładowczych, a nie wielkich akceleratorów – to tam po raz pierwszy eksperymentalnie „rozkręcano śrubki” w strukturze materii.

- Badania wyładowań w rozrzedzonych gazach ujawniły istnienie promieni katodowych, których zachowanie w polach elektrycznych i magnetycznych wskazywało na strumień naładowanych cząstek, a nie rodzaj światła.

- Eksperymenty J. J. Thomsona z pomiarem stosunku ładunku do masy (e/m) promieni katodowych doprowadziły do identyfikacji elektronu jako uniwersalnego, ujemnie naładowanego składnika wszystkich atomów.

- Odkrycie elektronu podważyło pojęcie atomu jako cząstki niepodzielnej i zapoczątkowało modele atomu z wewnętrzną strukturą, otwierając drogę do całej współczesnej fizyki cząstek.

- Lampy próżniowe stały się jednocześnie narzędziem badawczym i fundamentem rewolucji technologicznej – umożliwiły rozwój elektroniki (diody, triody, wzmacniacze) oraz pierwszych metod kontrolowania wiązek cząstek.

- Doświadczenia z lampami próżniowymi nauczyły fizyków tworzenia i sterowania wiązkami cząstek, pracy w wysokiej próżni i podstaw detekcji promieniowania, co bezpośrednio przygotowało grunt pod budowę akceleratorów cząstek.

- Rozwój od prostych lamp do Wielkiego Zderzacza Hadronów ilustruje zasadę: aby badać coraz mniejsze struktury materii, potrzebne są coraz wyższe energie zderzeń i coraz bardziej zaawansowana aparatura detekcyjna.